Illyasviel氏が FramePack というリポジトリを公開しました。

最低6GBのGPUメモリで1分以上の動画が生成できるという、いままでにないローカルAI動画生成ツールです。

動画生成の種類としては Image To Video(I2V) にあたるようです。

前置き

実行環境

- Windows 11

- RAM 32GB

- Nvidia RTX 4080 16GB

- Python 3.10

- CUDA Toolkit 12.8

セットアップ

リポジトリをクローンします。

PowerShell

git clone https://github.com/lllyasviel/FramePack.git

cd FramePack次に必要なパッケージをインストールします。

- Pythonのバージョン等は適宜読み替えてください。

- typing-extensions は Python<3.11 の場合のみ必要です。

- Tritonのwheelはここからダウンロード。

PowerShell

py -3.10 -m venv venv

.\venv\Scripts\Activate.ps1

pip install typing-extensions>=4.10.0

pip install torch torchvision torchaudio xformers>=0.0.29.post3 --index-url https://download.pytorch.org/whl/cu126

pip install -r requirements.txt

pip install sageattention==1.0.6

pip install '.\triton-3.2.0-cp310-cp310-win_amd64.whl'動画の生成

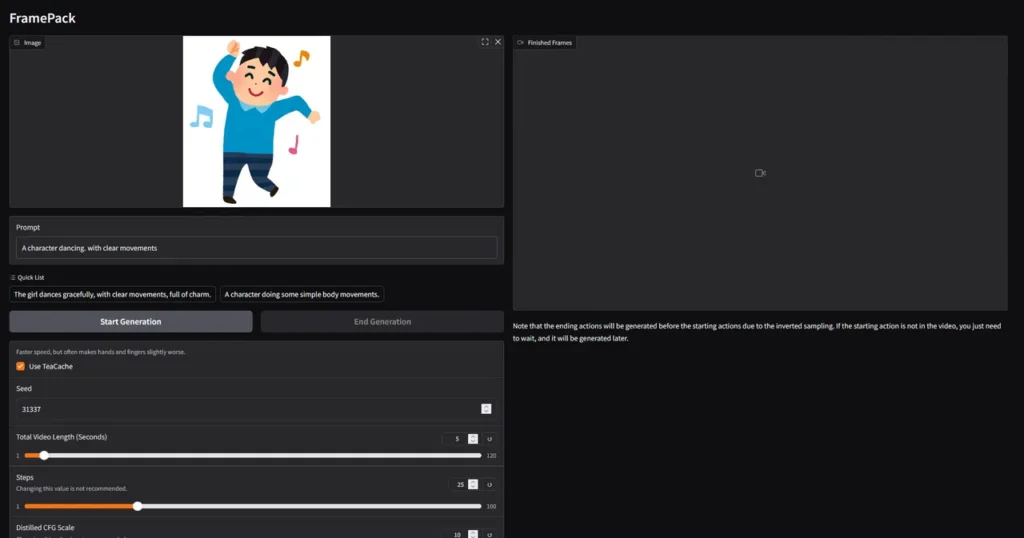

demo_gradio.py を実行しWebUIを起動。

初回起動時にモデルがダウンロードされます(40GB程度)

PowerShell

python demo_gradio.pyhttp://127.0.0.1:7860/ をブラウザで開き

いらすとや さんのダンスしている男性のイラストを入力し、5秒間の動画を生成してみました。

生成時間は10分くらいでした。

エラー対応

次のようなエラーが出た場合、

PowerShell

ImportError: DLL load failed while importing cuda_utils: 指定されたモジュールが見つかりません。以下のフォルダを削除して再度実行。

PowerShell

C:\Users\<ユーザー名>\.triton

C:\Users\<ユーザー名>\AppData\Local\Temp\torchinductor_<ユーザー名>他の環境で作成されたキャッシュによるエラーのようです。

感想

動画生成中に途中経過をファイルに出力してくれるの地味に便利。この点も今までの動画生成と違った特徴かもしれません。

コメント